NovelAI alias NAI Diffusion ist ein Anime-Bildgenerator, der im Oktober 2022 veröffentlicht wurde.

Für die Nutzung des Tools ist ein monatliches Abonnement erforderlich, wobei der günstigste Tarif $10 beträgt.

Du kannst NovelAI jedoch kostenlos auf deinem eigenen Computer ausführen und erhältst genau die gleichen Ergebnisse wie die kostenpflichtige Version:

Der Installationsprozess dauert 10 Minuten, abzüglich der Downloadzeiten. Du brauchst etwa 10 GB freien Speicherplatz auf deiner Festplatte.

Häufige Punkte der Verwirrung:

- Modelle sind Dateien, die mit dem Checkpoint-Erweiterung (.ckpt). Sie werden verwendet, um ein bestimmtes Genre von Bildern zu erzeugen.

- Sowohl die offizielle Website als auch das geleakte Modell werden als NAI Diffusion oder NovelAI.

- Das durchgesickerte Modell wird manchmal mit seinem Dateinamen bezeichnet, animefull, oder animefull_final

In dieser Anleitung zeigen wir dir, wie du das NovelAI/NAI Diffusion Modell mit der AUTOMATIC1111 Benutzeroberfläche herunterlädst und ausführst.

Los geht’s!

Installation

Bevor du mit der Installation fortfährst, sind hier die empfohlenen Spezifikationen:

- 16GB RAM

- NVIDIA-Grafikprozessor (GTX 7xx oder neuer) mit mindestens 2 GB VRAM (AMD-Grafikprozessoren funktionieren auch, aber NVIDIA wird empfohlen)

- Linux oder Windows 7/8/10/11 oder Mac M1/M2 (Apple Silicon)

- 10 GB Festplattenspeicher (einschließlich Modelle)

1. Lade die Modelldatei herunter

Das Modell ist alles, worauf die KI trainiert wurde und was sie erzeugen kann. Modelldateien enden auf ‚.ckpt‚, was für ‚Kontrollpunkt‘ steht.

Wie bereits erwähnt, werden wir die animefull (so nennt man das NovelAI-Modell).

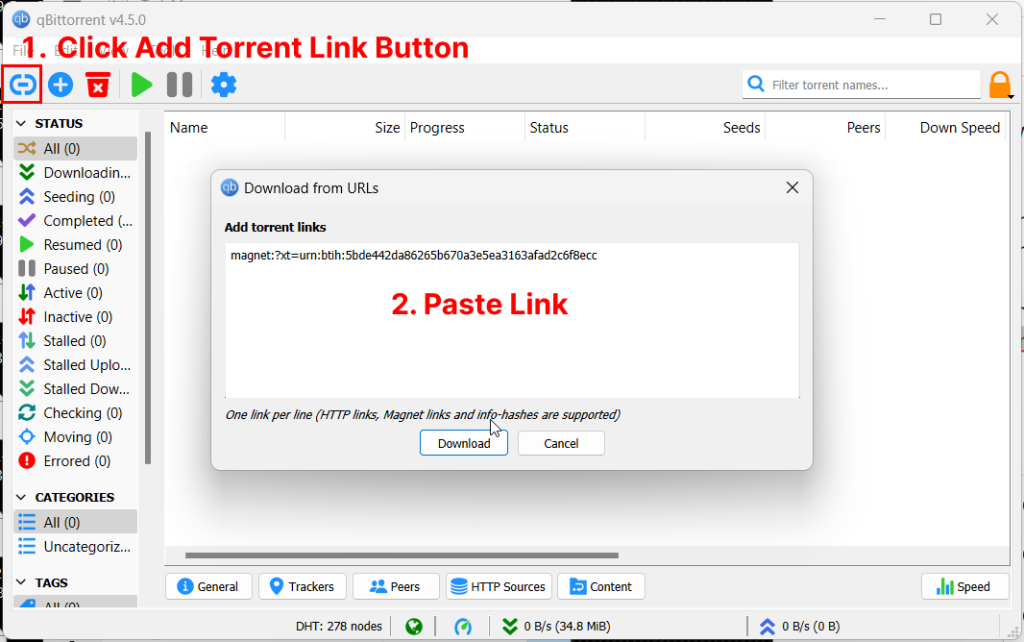

Lade dir einen Torrent-Client herunter, wenn du noch keinen hast. Ich empfehle qBittorrent (funktioniert unter Windows/macOS/linux).

Füge den folgenden Torrent-Magnetlink hinzu:

magnet:?xt=urn:btih:5bde442da86265b670a3e5ea3163afad2c6f8ecc

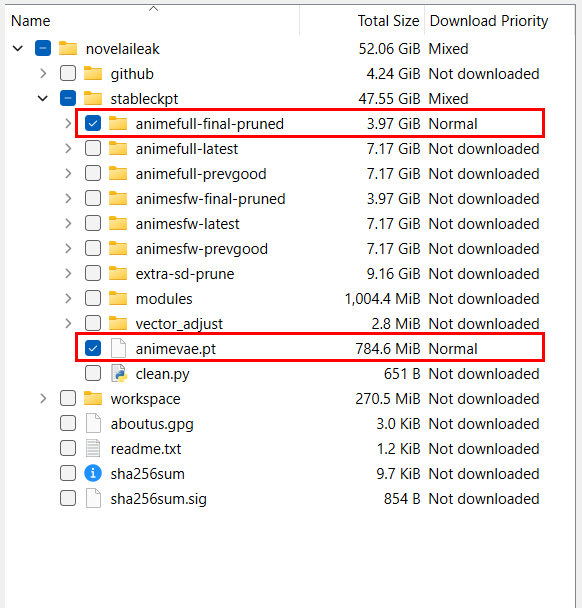

Deselektiere alles bis auf den Unterordner „animefull-final-pruned“ und die Datei „animevae.pt“ (beide befinden sich in der /stableckpt Ordner)

Du wirst feststellen, dass es folgende Dateien gibt beschnitten Modelle und unpruned Modelle. Ein beschnittenes Modell ist nur ein komprimiertes Modell. Die meisten Leute verwenden das beschnittene Modell.

Während das Modell im Hintergrund heruntergeladen wird, kannst du mit dem nächsten Schritt fortfahren.

2. Lade die Web UI herunter

Dies ist die Benutzeroberfläche, die du zum Ausführen der Generationen verwenden wirst.

Die beliebteste Benutzeroberfläche ist AUTOMATIC1111’s Stable Diffusion WebUI.

Ich habe ein paar Apps ausprobiert und ich kann verstehen, warum die Leute AUTOMATIC1111 lieben. Die Entwickler sind blitzschnell und erweitern die ohnehin schon beeindruckenden und robusten Funktionen ständig.

Du wirst feststellen, dass es die Stabile Diffusion Schnittstelle.

Stable Diffusion ist der Name der offiziellen generischen Modelle, die von StabilityAI veröffentlicht werden, aber umgangssprachlich wird er für alle Diffusionsmodelle verwendet.

Wenn also jemand von „anime stable diffusion“ spricht, meint er höchstwahrscheinlich nicht das allgemeine Modell, sondern ein fein abgestimmtes Modell wie NAI Diffusion.

Hier sind die Installationsanweisungen für die WebUI, abhängig von deiner Plattform. Sie werden in neuen Tabs geöffnet, so dass du zu dieser Anleitung zurückkehren kannst, nachdem du die WebUI-Installation abgeschlossen hast:

- Installation für Windows (NVIDIA GPU): Anleitung

- Installation für Windows (AMD-GPU): Anleitung

- Installation für Apple Silicon (Mac M1/M2): Anleitung

- Installation für Linux: instructions

3. Platziere das Modell im Web UI Ordner

Nachdem dein Modell heruntergeladen wurde, gehst du in den Ordner „novelaileak/stableckpt"

Du brauchst die folgenden Dateien:

model.ckptim Ordnerstableckpt/animefull-final-pruned- Dies ist die Modelldatei. Das ist die einzige Datei, die du wirklich brauchst.

config.yamlim Ordnerstableckpt/animefull-final-pruned- Diese Datei legt einige modellspezifische Konfigurationsdetails fest

animevae.ptim Ordnerstableckpt- Diese

- Diese

Kopiere diese 3 Dateien in den Ordner stable-diffusion-webui/models/Stable-diffusion.

(stable-diffusion-webui ist der Ordner, in dem sich die Web-UI befindet, die du im vorherigen Schritt heruntergeladen hast)

Benenne die Dateien wie folgt um:

model.ckpt->nai.ckptconfig.yaml->nai.yamlanimevae.pt->nai.vae.pt(schreibe es genau so)

Du kannst diese Dateien benennen, wie du willst, solange der Name vor dem ersten „.“ derselbe ist.

Da du alle zukünftigen Modelle in diesem Ordner ablegen wirst, wähle einen beschreibenden Namen, der dir hilft, dich an dieses Modell zu erinnern.

4. Starte die WebUI

- Windows: Doppelklick auf

webui-user.bat(Windows Batch File), um zu starten - Mac: Führe den Befehl aus

./webui.shim Terminal aus, um zu starten - Linux: Führe den Befehl

webui-user.shim Terminal aus, um zu starten

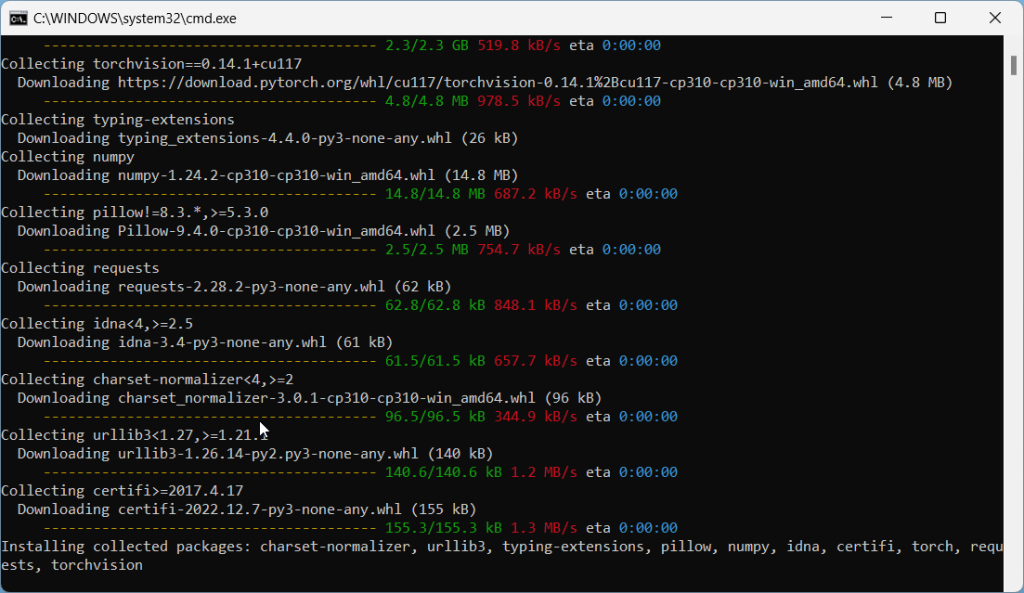

Beim ersten Start wird die WebUI einige zusätzliche Module herunterladen und installieren. Das kann ein paar Minuten dauern.

Häufige Probleme bei diesem Schritt:

RuntimeError: Torch konnte nicht installiert werden.

Fix: Stelle sicher, dass du Python 3.10.x installiert hast. Typ python --version in deine Eingabeaufforderung ein. Wenn du eine ältere Version von Python hast, musst du sie deinstallieren und neu installieren. Python-Website.

Fix #2: Deine Python-Version ist korrekt, aber du bekommst immer noch den gleichen Fehler? Lösche die venv Verzeichnis in stable-diffusion-webui und führe erneut aus webui-user.bat

RuntimeError: Middleware kann nicht hinzugefügt werden, nachdem eine Anwendung gestartet wurde

Fix: Gehe in dein stable-diffusion-webui Ordner, klicke mit der rechten Maustaste -> Öffne Terminal. Kopiere diese Zeile und füge sie in das Terminal ein und drücke die Eingabetaste:

.venvScriptspython.exe -m pip install --upgrade fastapi==0.90.1Weitere häufige Probleme findest du in der Fehlersuche Abschnitt.

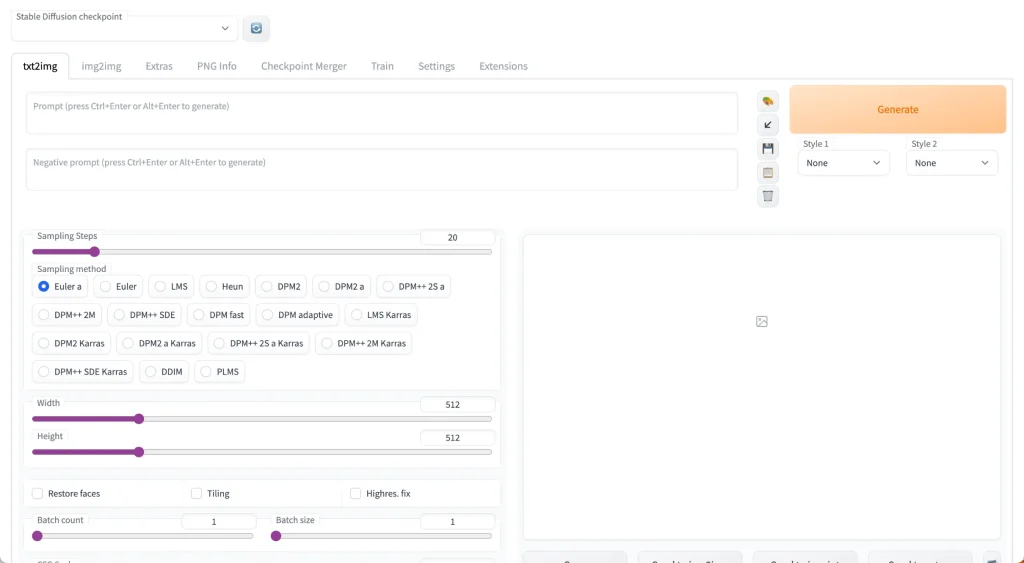

WebUI im Browser öffnen

In meiner Eingabeaufforderung erhalte ich die Erfolgsmeldung Running on local URL: http://127.0.0.1:7860

Ich öffne also meinen Webbrowser und gehe zu folgender Adresse: http://127.0.0.1:7860.

Alles andere funktioniert, aber nicht die Webadresse

- Vergewissere dich, dass du nicht “ “ getippt hast.

https://“ aus Versehen eingegeben hast. Die Adresse sollte mit “ “ beginnen.http://„ - In diesem Beispiel lautet meine Webadresse

http://127.0.0.1:7860. Deine könnte anders lauten. Bitte lies die Erfolgsmeldung in der Eingabeaufforderung sorgfältig durch, um die richtige Webadresse zu finden.

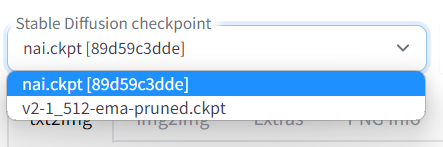

Oben findest du einen Schalter namens „Stable Diffusion Checkpoint“.

Damit kannst du zu einem beliebigen Modell wechseln, das du im stable-diffusion-webui/models/Stable-diffusion Ordner abgelegt hast. Wir wählen das Modell, das wir umbenannt haben nai.ckpt zuvor umbenannt haben.

Wenn du das Modell in den Ordner legst, nachdem du die WebUI gestartet hast, musst du die WebUI neu starten, um das Modell zu sehen.

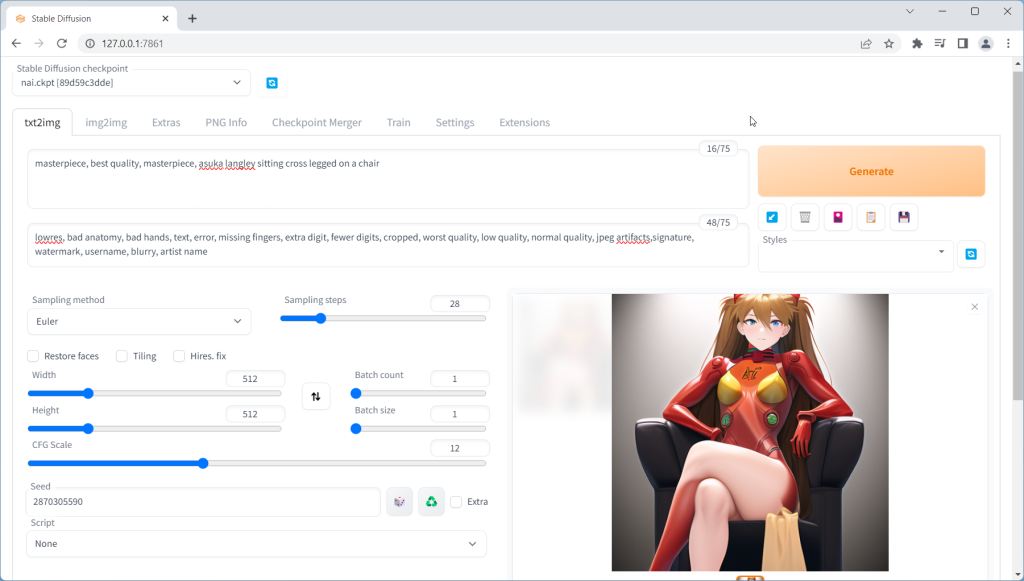

5. Kalibrieren mit Asuka

Hallo Asuka ist ein Kalibrierungstest, mit dem du überprüfen kannst, ob du alles richtig installiert und konfiguriert hast.

Die kostenpflichtige Version von NovelAI erzeugt dieses Bild von Asuka aus Evangelion mit 95%-100% Genauigkeit wenn du die richtigen Einstellungen verwendest:

Wenn du dieses Bild mit deiner neuen Stable Diffusion & NAI-Installation nachbilden kannst, hast du NovelAI erfolgreich emuliert.

Gehe zum txt2img Registerkarte. Gib die folgenden Werte ein genau:

- Prompt:

masterpiece, best quality, masterpiece, asuka langley sitting cross legged on a chair - Negative Aufforderung:

lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts,signature, watermark, username, blurry, artist name - Sampling-Schritte:

28 - Probenahmeverfahren:

Euler - Breite:

512 - Höhe:

512 - CFG Maßstab:

12 - Saatgut:

2870305590 - Dann gehst du zum

SettingsRegisterkarte. Klicke auf denStable DiffusionAbschnitt und suche den Schieberegler mit der AufschriftClip skip. Stelle ihn auf2. Dann klickeApply Settingsam oberen Rand.

Klick auf das große Generate Schaltfläche in der oberen rechten Ecke und warte, bis das Bild fertig ist:

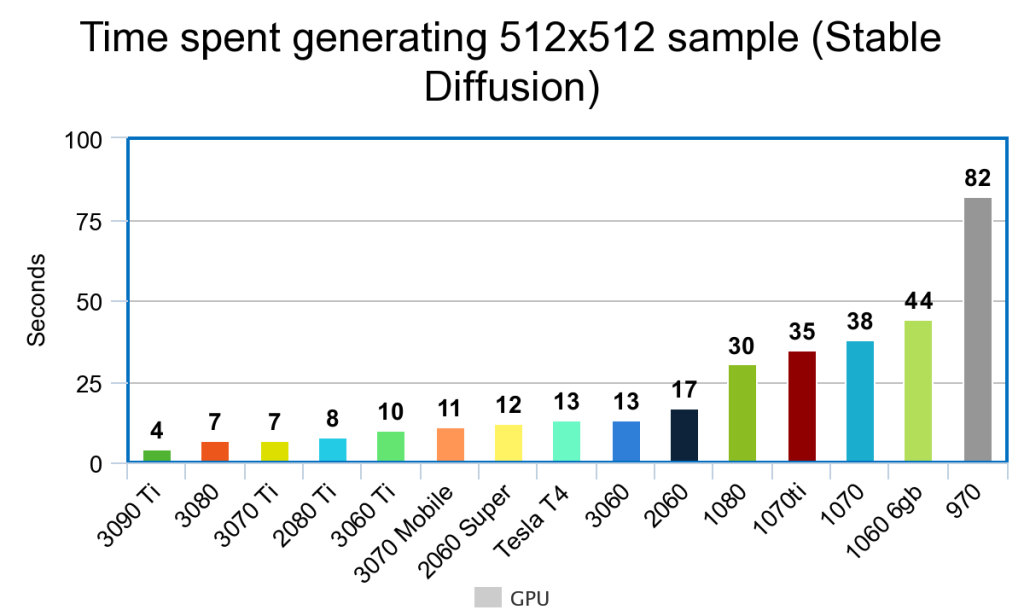

Wie lange dauert es, ein Bild zu erzeugen?

Hier ist eine grobe Schätzung für die Bilderzeugungszeit, abhängig von deinem Grafikprozessor:

Du kannst davon ausgehen, dass diese Benchmark-Zeiten sinken werden, da die Entwickler die Software für immer schnellere Generationen optimieren.

Brauchst du einen besseren Grafikprozessor, um Bilder schneller zu erzeugen? Schau dir das an praktischen GPU-Leitfaden.

Meine Asuka ist verkorkst!

Du willst ein Ergebnis erhalten, das fast genau mit dem Ziel Asuka übereinstimmen. „Nah genug“ bedeutet wahrscheinlich, dass etwas nicht stimmt.

Hier sind einige Gründe, warum du vielleicht nicht den richtigen Asuka bekommst:

- Du verwendest nicht die VAE (

.vae.pt) Datei und die Konfiguration (.yaml) Datei. Prüfe Schritt 3 wieder. - Stelle sicher, dass du die

Eulerfür den Sampler und nichtEulera - Stelle sicher, dass du das richtige Modell verwendest. Überprüfe die

Stable Diffusion checkpointDropdown oben. Wenn dein Modell korrekt ist, wird die Nummer[89d59c3dde]oder[925997e9]sollte nach dem Modellnamen erscheinen. - Überprüfe, ob du alle Einstellungen richtig eingegeben hast: Prompt (hast du das Kopieren eines Buchstabens vergessen?), Negative Prompt, Steps, CFG-Skala, Seed, Clip Skip in den Einstellungen usw.

- Du führst Stable Diffusion auf deinem CPU. Das ist nicht nur sehr langsam, sondern du wirst auch den Asuka-Test nicht bestehen können.

- Du hast eine NVIDIA GTX 1050ti. Es ist bekannt, dass diese spezielle GPU den Test nicht abschließen kann.

- Du verwendest eine Mac. Macs sind dafür bekannt, dass sie Probleme haben, den Test abzuschließen.

Vollständige Liste der häufiger Fehler mit Beispielen.

Mach dir nichts draus, wenn dein Computer den Asuka-Test nicht bestehen kann. Du kannst immer noch qualitativ hochwertige Bilder erzeugen (das bedeutet nur, dass du NovelAI nicht 1:1 nachbilden kannst).

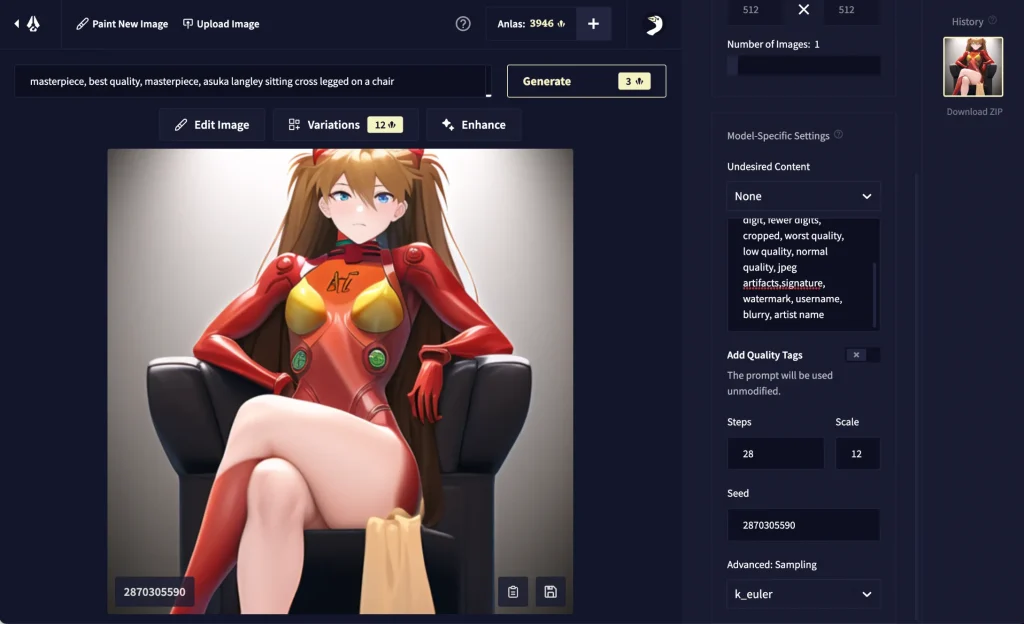

NovelAI-Emulation

Um dir zu zeigen, wie nah die Emulation tatsächlich ist, habe ich die genauen Asuka-Testeinstellungen auf der offiziellen NovelAI-Website eingegeben:

Hier sind die Ergebnisse im Vergleich:

Du wirst feststellen, dass der einzige Unterschied in der Schärfe der Trennung des roten Beins besteht. Dieser Unterschied ist akzeptabel, weil er durch das Starten der WebUI mit benutzerdefinierten Parametern (-medvram, -lowvram oder -no-half ) verursacht wird.

Du kannst die gleichen Einstellungen wie beim Asuka-Test verwenden, um jedes NovelAI-Bild zu emulieren. Das heißt:

- Setze den Sampler auf Euler (Nicht Euler A)

- Verwende 28 Steps

- CFG-Skala einstellen auf 11

- verwenden

masterpiece, best qualityam Anfang aller Prompts - Verwende

nsfw, lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry, artist nameals negative Aufforderung - Klicke auf der Registerkarte Einstellungen auf den Unterabschnitt Stabile Diffusion und ändere den Clip-Sprung Schieberegler zu 2 und klicke dann auf „

Apply settings„

Prompting

Grundlagen

- AUTOMATIC1111 speichert deinen Bildverlauf nicht! Speichere deine Lieblingsbilder oder verliere sie für immer.

- Beginne deine Eingabeaufforderungen mit

masterpiece, best quality(die NovelAI-Website macht das standardmäßig). - Beginne in den Negative Prompts mit den folgenden Angaben:

lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry, artist name - Verwende

-1im Seed-Feld, um ihn zu randomisieren, oder gib einen Seed an, um die Konsistenz zwischen den Generationen zu gewährleisten.

Ich habe einige detaillierte Souffleurtechniken geschrieben, um deine Bildergebnisse zu verbessern. Wenn du diesen Leitfaden verwendest, ersetze {} mit (). Stabile Diffusion verwendet () während die NovelAI-Website {}.

Danbooru Tags

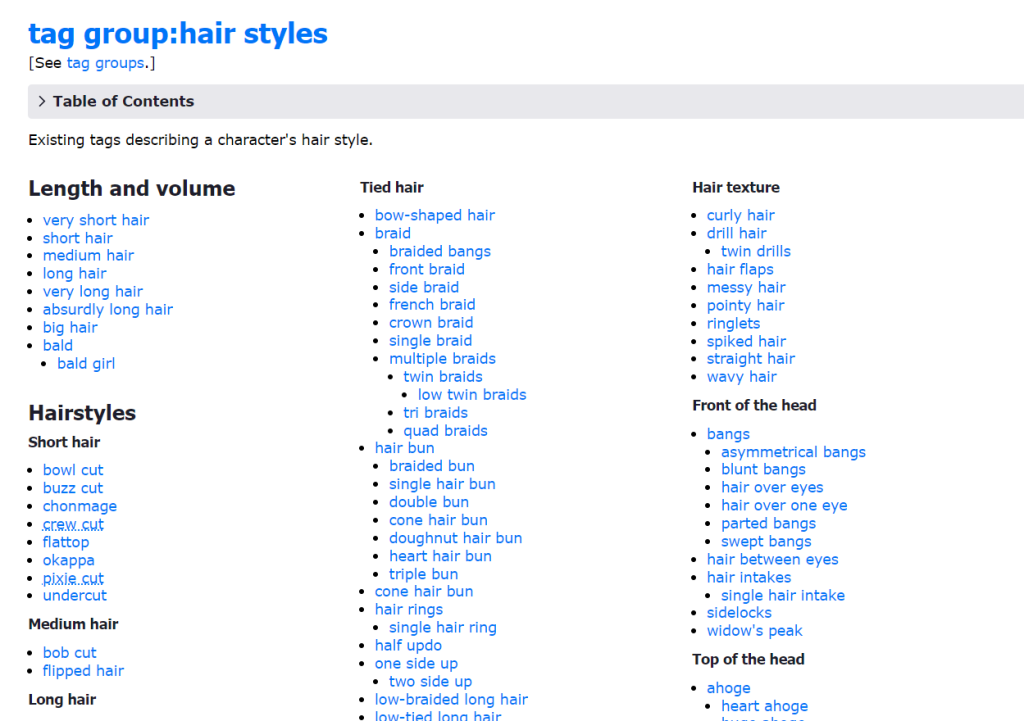

Der schnellste Weg, um dein Prompting zu verbessern, ist ein Blick auf Danbooru-Tag-Gruppen.

Für die Unwissenden, Danbooru ist das größte Anime-Imageboard (und eine der 1000 meistbesuchten Websites der Welt).

Alle Anime-Modelle nutzen Danbooru für alle/einen Teil ihrer Trainingsdaten.

Der Grund, warum sich Danbooru so gut als Datensatz für KI/ML-Modelle eignet, ist sein robustes Tagging-System. Jedes einzelne Bild hat Tags, die alles im Bild zusammenfassen, von den Hauptkategorien (Künstler, Charakter, Fandom) bis hin zu den kleinsten Details (‚feet out of frame‚, ‚holding food‚, ‚purple bowtie‚, etc).

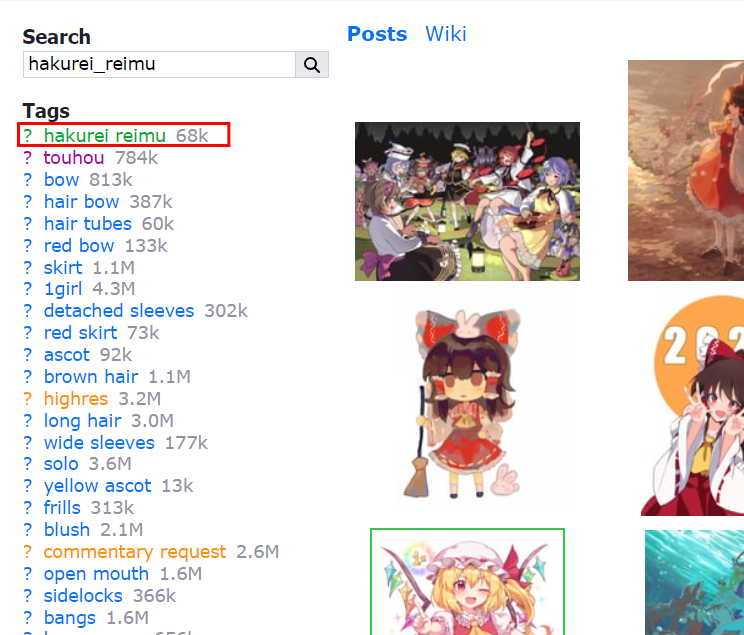

Wenn ein Danbooru-Tag mehr als 1.000 Bilder hat, ist die Wahrscheinlichkeit groß, dass NovelAI „weiß“, was es ist. Überprüfe einzelne Tags, um sicherzustellen, dass sie genug Bilder haben.

Das erklärt, warum NovelAI einige „beliebte“ Charaktere nicht erzeugen kann.

Die Charaktere haben einfach nicht genug Fanart auf Danbooru.

masterpiece, best quality, hakurei reimu

masterpiece, best quality, hatsune mikuTipp: Die besten Ergebnisse erzielst du, wenn du die Namen der Charaktere genau so schreibst, wie sie in Danbooru markiert sind.

Prompting-Leitfäden

Hier sind die besten Ressourcen, die ich bisher gefunden habe (schick mir eine E-Mail, wenn du etwas hast, das du dieser Liste hinzufügen möchtest):

P1atdev

Die umfangreichste NovelAI-Prompt-Bibliothek für alle Zeichenfunktionen. Nur auf Japanisch.

https://p1atdev.notion.site/p1atdev/611b109989c54ffca6219edd95d1b247

Kodex der Quintessenz

Gigantischer chinesischer Wälzer mit schnellem Wissen, aufgeteilt in mehrere Schriftrollen.

Modelle für den nächsten Versuch

NovelAI/NAI Diffusion ist sicherlich das bekannteste Anime-Modell.

Natürlich wirst du auch andere Modelle ausprobieren wollen. Hier sind einige Empfehlungen:

NovelAI (NAI Diffusion)

Die, die du gerade installiert hast. Ich empfehle die Unterstützung der kostenpflichtige Version wenn du es magst.

Für weitere Modelle, schau dir das an vollständige Liste der Anime-Modelle.

Fazit

Jeden Tag kommen neue Modelle und Funktionen für die WebUI auf den Markt. Dieser Artikel wird im Laufe der Zeit aktualisiert. In der Zwischenzeit kannst du dich über die neuesten Nachrichten zu Stable Diffusion informieren oder dich an der Diskussion beteiligen:

Fehlersuche

RuntimeError: Torch konnte nicht installiert werden.

Fix: Stelle sicher, dass du Python 3.10.x installiert hast. Typ python --version in deine Eingabeaufforderung ein. Wenn du eine ältere Version von Python hast, musst du sie deinstallieren und neu installieren. Python-Website.

Fix #2: Deine Python-Version ist korrekt, aber du bekommst immer noch den gleichen Fehler? Lösche die venv Verzeichnis in stable-diffusion-webui und führe erneut aus webui-user.bat

RuntimeError: Middleware kann nicht hinzugefügt werden, nachdem eine Anwendung gestartet wurde

Fix: Gehe in dein stable-diffusion-webui Ordner, klicke mit der rechten Maustaste -> Öffne Terminal. Kopiere diese Zeile und füge sie in das Terminal ein und drücke die Eingabetaste:

.venvScriptspython.exe -m pip install --upgrade fastapi==0.90.1

0 Kommentare